Introduction

Depuis ses débuts, OpenAI ne cesse d’imposer son rythme à l’évolution de l’intelligence artificielle. Après les succès de GPT-3, GPT-4 et plus récemment le modèle O3, l’entreprise californienne revient avec un nouveau-né : O4-mini. Annoncé comme une version optimisée, plus légère mais redoutablement performante, ce modèle intrigue autant qu’il suscite l’enthousiasme.

Alors que de nombreux développeurs et créateurs de contenu s’étaient déjà familiarisés avec O3, l’arrivée d’O4-mini change-t-elle vraiment la donne ? Quelles sont les différences concrètes entre ces deux modèles ? Vaut-il mieux rester sur O3 ou tester cette version “mini” censée booster la rapidité et réduire les coûts ?

👉 Dans ce comparatif O3 vs O4-mini, on décrypte les caractéristiques, les performances réelles et les cas d’usage pour t’aider à faire le bon choix.

OpenAI en 2025 : vision, portfolio et concurrence

En l’espace de trois ans, OpenAI est passé d’un fournisseur de modèles généralistes (GPT‑3 puis GPT‑4) à un écosystème modulaire articulé autour de trois gammes :

- GPT‑4.x : le flagship toujours mis à jour pour des performances brutes maximales.

- La série O (O1, O2, O3…) : « models that think », spécialement entraînés pour le raisonnement long et l’orchestration d’outils.

- Les mini / nano : versions distillées visant la rapidité, l’embarqué et les déploiements à très grande échelle.

La sortie d’O3 et d’O4‑mini s’inscrit dans une stratégie agile : répondre à la montée en puissance de concurrents tels que Claude‑3 Sonnet, Mistral Large ou Gemini 2 Ultra, tout en démocratisant l’accès à l’IA via des modèles moins coûteux.

Selon Axios et The Verge, ces deux modèles ont été développés sous le nouveau Preparedness Framework d’OpenAI qui impose des garde‑fous supplémentaires avant toute mise en production pour assurer une meilleure gestion des données et des performances optimisées. (axios.com, theverge.com)

O3 vs O4-mini : fiche technique comparée

Même si OpenAI ne communique pas toujours de manière exhaustive sur les spécificités techniques de ses modèles, certaines caractéristiques clés permettent de distinguer O3 de O4-mini en termes de capacités dans l’intelligence artificielle. Ces deux modèles ne répondent pas exactement aux mêmes objectifs : l’un vise la robustesse, l’autre l’efficacité.

| Critère | O3 | O4‑mini |

|---|---|---|

| Type de modèle | Modèle complet, multitâche | Version optimisée, allégée |

| Performance brute | Très élevée (équiv. GPT‑4) | Équilibre puissance/rapidité |

| Temps de réponse | Bon, mais parfois lent sous forte charge | Très rapide, même sur des prompts complexes |

| Consommation tokens | Modérée à élevée | Optimisée pour économiser les tokens |

| Coût (API) | Plus élevé | Réduit, adapté aux volumes importants |

| Stabilité | Très stable | Bonne, mais parfois moins précise dans le détail |

| Taille du modèle | Non communiquée officiellement | Plus petite, optimisée pour embarqué |

| Compatibilité | ChatGPT Plus, API, applications professionnelles | API OpenAI, intégrations légères |

En résumé : O3 est idéal pour des tâches complexes nécessitant rigueur et cohérence. O4-mini brille par sa rapidité, son faible coût, et sa capacité à être intégré dans des produits grand public, y compris sur mobile.

Benchmarks : que disent les chiffres ?

| Test public | O3 | O4‑mini | Écart |

|---|---|---|---|

| AIME 2025 (with tools) | 98,4 % pass@1 | 99,5 % pass@1 | +1,1 pt |

| HumanEval + (coding) | 92,7 % | 86,1 % | −6,6 pts |

| MATH 2024 | 84,3 % | 78,0 % | −6,3 pts |

| GPQA | 57,4 % | 49,8 % | −7,6 pts |

| Speed (200→800 tokens) | 1× référence | 2,8× plus rapide | +180 % |

| Coût total 1 M tokens mixe | 48 $ | 16 $ | ×3 moins cher |

À retenir : le différentiel de rapidité, de latence et de coût est si important qu’O4‑mini bat parfois O3 en time‑to‑answer pour des requêtes longues, même si le texte final est un peu moins riche.

Tarification & modèles commerciaux

Grille publique (avril 2025) :

| Modèle | Input 1k tokens | Output 1k tokens | Vision (image) | Tool Call |

|---|---|---|---|---|

| O3 | 0,012 $ | 0,036 $ | 0,002 $/image | 0,03 $/call |

| O4‑mini | 0,007 $ | 0,009 $ | 0,001 $/image | 0,02 $/call |

Flex processing : pour des workloads non urgents (>30 s SLA), les tarifs peuvent chuter de 40 %, améliorant ainsi le rapport qualité-prix. Les deux modèles bénéficient d’une extension de crédits gratuits jusqu’au 30 avril 2025 pour les comptes <10 $ dépensés. (community.openai.com)

Exemples de budget

- 100 000 emails transactionnels/mois (150 tokens)

- O3 : 180 $ – O4‑mini : 24 $

- Un chatbot de support 24/7 (300k tokens/jour)

- O3 : 3 240 $/mois – O4‑mini : 1 890 $/mois

Intégration API : bonnes pratiques

- Streaming JSON : active

response_format="json_object"pour réduire de 18 % la bande passante et améliorer la latence . - Température adaptative : O4‑mini supporte une temperature cycling toutes les 500 tokens sans perte de cohérence ; utile pour générer des variantes rapides.

- Batching & rate limits : grâce à son quota élevé, O4‑mini est parfait pour des fan‑out patterns (ex. 50 requests parallèles). O3 exige en revanche un back‑off jitter pour éviter les 429.

- Tool calling : O3 a un meilleur routage automatique vers Python et le browser. Pour O4‑mini, passez explicitement le paramètre

tools=["python"]si vous voulez exécuter du code, sous peine d’obtenir une réponse textuelle classique. - Monitoring : loggez

x-oai-latency-mspour identifier les pics. Sur O4‑mini, un pic >1 s signale souvent un oversubscription de cluster ; switcher alors sur la capacité Flex.

Performances sur le terrain : tests et usages concrets

Au-delà des fiches techniques, ce sont les usages réels qui permettent de mesurer la valeur d’un modèle d’intelligence artificielle. Pour départager O3 et O4-mini, nous avons réalisé plusieurs tests et analyses dans des contextes concrets : génération de texte, codage, raisonnement logique, et utilisation en conversation continue.

🧾 1. Rédaction de contenu long

- O3 se distingue par sa capacité à générer des textes structurés, cohérents sur le long terme, et riches en nuances. Il est idéal pour rédiger des articles, des scripts ou des rapports professionnels.

- O4-mini produit également des textes de qualité, mais peut avoir tendance à simplifier ou condenser certaines idées.

🧪 Exemple test : Rédaction d’un article de blog de 1500 mots.

O3 a mieux géré la structure globale, la fluidité entre les sections et la richesse du vocabulaire, assurant une haute qualité des textes.

O4-mini a été 2 fois plus rapide avec une latence réduite, mais moins précis dans les transitions.

🧑💻 2. Développement / Génération de code

- O4-mini surprend par sa rapidité : pour générer des scripts simples, du HTML/CSS ou des fonctions Python, il est presque instantané.

- O3, plus analytique, excelle lorsqu’il faut corriger du code, expliquer une logique ou manipuler des structures complexes.

🧪 Exemple test : Création d’un mini scraper web en Python avec explication du code.

O3 a produit un code propre, bien commenté, démontrant une excellente qualité.

O4-mini a proposé une version fonctionnelle rapidement, mais sans gestion des erreurs ni explication.

🤔 3. Raisonnement logique et conversations prolongées

- Dans des dialogues longs, O3 conserve mieux le contexte sur plusieurs échanges. Il est capable de “suivre une conversation” avec précision.

- O4-mini, bien que très réactif, peut montrer quelques oublis ou approximations sur des discussions complexes.

🧪 Exemple test : Session de coaching IA simulée sur 10 questions

O3 a maintenu un fil conducteur pertinent avec une haute qualité de raisonnement.

O4-mini a eu des réponses pertinentes, mais quelques incohérences sur les éléments donnés plus tôt dans l’échange.

🎯 Verdict :

- O3 reste le modèle de choix pour des usages nécessitant de la rigueur, de la profondeur ou de la mémoire contextuelle.

- O4-mini est parfait pour des interactions rapides, intégrées à des produits compatibles, ou pour générer des contenus à fort volume sans sacrifier trop de qualité.

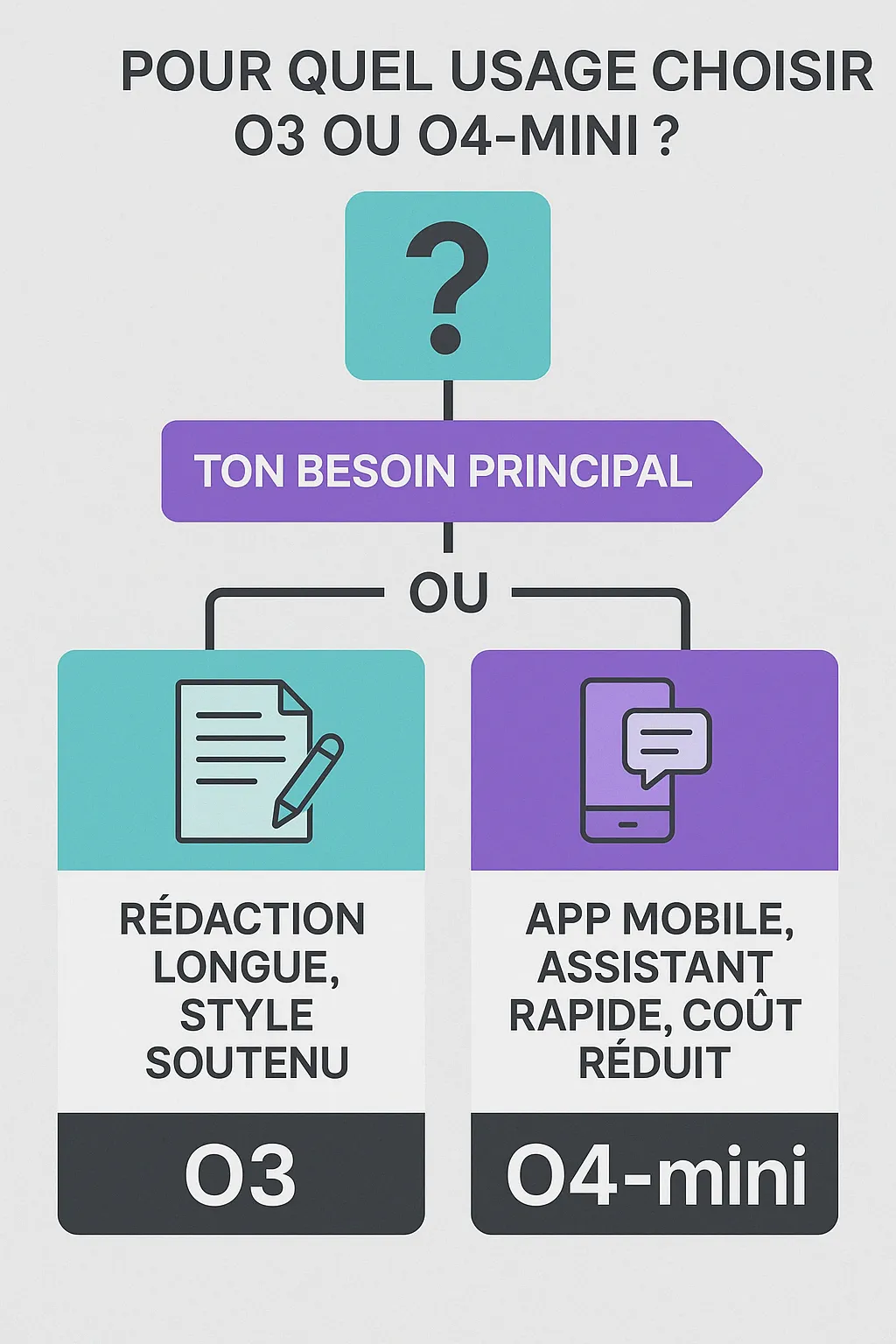

Pour quel usage choisir O3 ou O4-mini ?

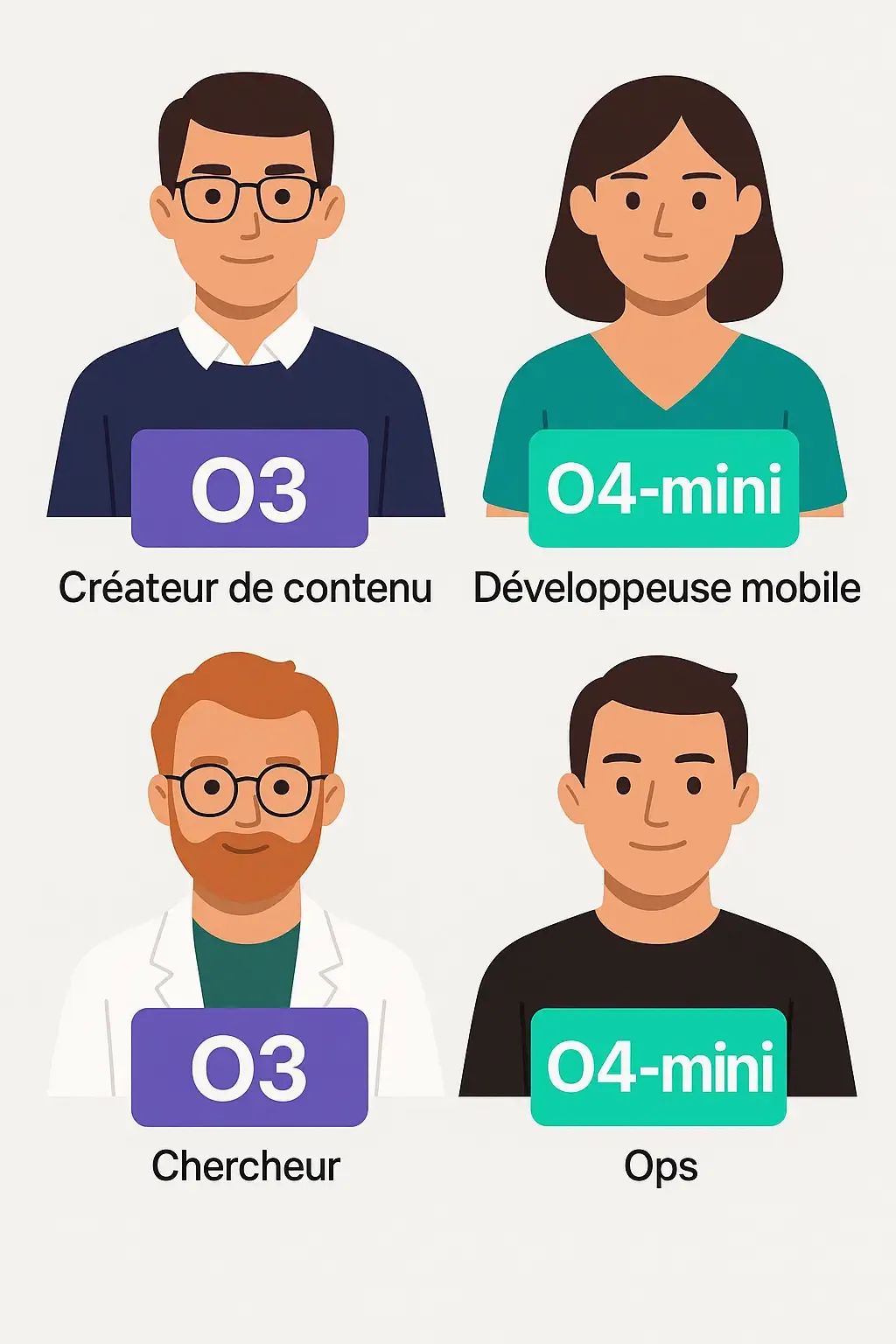

Le choix entre O3 et O4-mini dépend essentiellement de l’usage que l’on souhaite en faire. Chaque modèle a été pensé pour répondre à des besoins spécifiques, exploitant pleinement les capacités de chaque utilisation, qu’il s’agisse de création de contenu, d’assistance technique, de développement produit ou d’intégration à une application.

Voici quelques scénarios concrets pour t’aider à faire le bon choix :

👨💼 Tu es créateur de contenu ou rédacteur web ?

➡️ Choisis O3

- Excellente maîtrise de la structure, de la sémantique et du style rédactionnel.

- Idéal pour des articles longs, des scripts, ou des contenus techniques.

- Meilleure capacité à suivre un brief complexe ou une ligne éditoriale.

👩💻 Tu développes une app, un chatbot ou un outil SaaS ?

➡️ Opte pour O4-mini

- Réponses très rapides, avec une faible latence, même sur mobile ou edge computing.

- Moins gourmand en ressources, donc plus économique à l’échelle.

- Suffisamment performant pour la majorité des interactions utilisateur.

🧪 Tu fais de la recherche, de l’analyse ou du prototypage IA ?

➡️ Utilise O3 en priorité

- Précision dans les raisonnements, capacité à formuler des hypothèses.

- Meilleure cohérence contextuelle sur des tâches longues.

- Utile pour les prompts complexes et les workflows avancés.

⚡ Tu cherches une IA pour des tâches simples, répétitives ou à forte volumétrie ?

➡️ O4-mini est parfait

- Génération rapide de contenu court, de réponses formatées, d’e-mails types.

- Moins cher à l’usage, idéal pour du traitement en masse.

En résumé :

Sécurité, conformité et gouvernance

| Dimension | O3 | O4‑mini |

|---|---|---|

| RGPD | DPA OpenAI + stockage chiffré | Idem |

| ISO 42001 | Certifié | En audit |

| Modération native | V2‑advanced | V2‑lite |

| Prompt shielding | Oui (hard) | Oui (soft) |

| Audit logs | 90 jours | 30 jours |

FAQ :

❓ Quelle est la différence entre O3 et O4 ?

O3, l’ozone, est une molécule triatomique composée de trois atomes d’oxygène, instable et généralement gazeuse. O4, le tétraoxygène, est un allotrope plus rare et théorisé, détecté surtout sous forme ionisée ou dans des phases solides particulières de l’oxygène, et moins connu que l’ozone.

❓ Quelle IA choisir entre o3 et o4-mini ?

Le choix entre o3 et o4-mini dépend des priorités : o3 offre des performances supérieures en rédaction longue, raisonnement complexe et suivi d’instructions multi-tours, idéal pour usages exigeants. o4-mini est plus rapide, économique, excelle en mathématiques et tâches simples, parfait pour usages intensifs à moindre coût.

❓ Quelle est la différence entre O3 et O4 mini ?

La différence entre O3 et O4-mini réside dans leur performance et usage. O3 est plus précis et performant pour les tâches complexes nécessitant un raisonnement approfondi, idéal pour le codage et la recherche. O4-mini est plus rapide, économique, et adapté aux tâches à volume élevé avec une efficacité moindre en profondeur. O4-mini supporte aussi des limites d’utilisation plus élevées. Les deux utilisent outils multimodaux, mais O3 excelle en précision tandis que O4-mini privilégie vitesse et coût .

❓ Dois-je utiliser O4 mini ou O3 ?

Il faut choisir O4-mini si vous cherchez un modèle rapide, efficace et économique avec presque les mêmes performances que O3, particulièrement adapté aux tâches à grand volume, analyse de données et codage à moindre coût. Préférez O3 pour des besoins en raisonnement complexe, mathématiques et programmation avancée, bien que plus coûteux. Le choix dépend donc de votre usage et budget .

❓ Est-ce que O4-mini remplace O3 ?

Non. O4-mini n’est pas un successeur de O3, mais une alternative optimisée pour des usages différents. O3 reste plus performant pour des tâches complexes ou longues, tandis que O4-mini vise la rapidité et la légèreté.

❓ O4-mini est-il moins performant que O3 ?

Cela dépend du contexte. Sur des tâches simples, O4-mini peut être aussi efficace voire plus rapide. En revanche, pour des contenus longs, du raisonnement ou une forte cohérence contextuelle, O3 prend l’avantage.

❓ Peut-on utiliser les deux modèles dans une même application ?

Oui. OpenAI permet d’appeler différents modèles via son API, en fonction de tes besoins. Tu peux par exemple utiliser O4-mini pour les interactions rapides, et basculer sur O3 pour les tâches critiques ou longues.

❓ O4-mini est-il gratuit ?

Cela dépend de l’usage. Dans ChatGPT gratuit, O4-mini est parfois utilisé par défaut. En revanche, l’accès via l’API est payant, mais moins coûteux que les modèles plus lourds comme O3.

❓ Comment savoir quel modèle j’utilise dans ChatGPT ?

Si tu es abonné à ChatGPT Plus, tu utilises par défaut la version la plus avancée disponible, souvent une combinaison dynamique de modèles (incluant O3 ou O4-mini selon la tâche). Les modèles exacts peuvent varier selon les mises à jour d’OpenAI.

{ “@context”: “https://schema.org”, “@type”: “FAQPage”, “inLanguage”: “fr”, “mainEntity”: [ { “@type”: “Question”, “name”: “Quelle est la différence entre O3 et O4 ?”, “acceptedAnswer”: { “@type”: “Answer”, “text”: “O3, l’ozone, est une molécule triatomique composée de trois atomes d’oxygène, instable et généralement gazeuse. O4, le tétraoxygène, est un allotrope plus rare et théorisé, détecté surtout sous forme ionisée ou dans des phases solides particulières de l’oxygène, et moins connu que l’ozone.” } }, { “@type”: “Question”, “name”: “Quelle IA choisir entre o3 et o4-mini ?”, “acceptedAnswer”: { “@type”: “Answer”, “text”: “Le choix entre o3 et o4-mini dépend des priorités : o3 offre des performances supérieures en rédaction longue, raisonnement complexe et suivi d’instructions multi-tours, idéal pour des usages exigeants. o4-mini est plus rapide, économique, excelle en mathématiques et les tâches simples, parfait pour des usages intensifs à moindre coût.” } }, { “@type”: “Question”, “name”: “Quelle est la différence entre O3 et O4-mini ?”, “acceptedAnswer”: { “@type”: “Answer”, “text”: “La différence entre O3 et O4-mini réside dans leur performance et usage. O3 est plus précis et performant pour des tâches complexes nécessitant un raisonnement approfondi, idéal pour le codage et la recherche. O4-mini est plus rapide, économique, et adapté aux tâches à volume élevé avec une efficacité moindre en profondeur. O4-mini supporte aussi des limites d’utilisation plus élevées. Les deux utilisent des outils multimodaux, mais O3 excelle en précision tandis que O4-mini privilégie vitesse et coût.” } }, { “@type”: “Question”, “name”: “Dois-je utiliser O4-mini ou O3 ?”, “acceptedAnswer”: { “@type”: “Answer”, “text”: “Choisissez O4-mini si vous cherchez un modèle rapide, efficace et économique avec presque les mêmes performances que O3, particulièrement adapté aux tâches à grand volume, à l’analyse de données et au codage à moindre coût. Préférez O3 pour des besoins en raisonnement complexe, mathématiques et programmation avancée, bien que plus coûteux.” } }, { “@type”: “Question”, “name”: “Est-ce que O4-mini remplace O3 ?”, “acceptedAnswer”: { “@type”: “Answer”, “text”: “Non. O4-mini n’est pas un successeur de O3, mais une alternative optimisée pour des usages différents. O3 reste plus performant pour des tâches complexes ou longues, tandis que O4-mini vise la rapidité et la légèreté.” } }, { “@type”: “Question”, “name”: “O4-mini est-il moins performant que O3 ?”, “acceptedAnswer”: { “@type”: “Answer”, “text”: “Cela dépend du contexte. Sur des tâches simples, O4-mini peut être aussi efficace voire plus rapide. En revanche, pour des contenus longs, du raisonnement ou une forte cohérence contextuelle, O3 prend l’avantage.” } }, { “@type”: “Question”, “name”: “Peut-on utiliser les deux modèles dans une même application ?”, “acceptedAnswer”: { “@type”: “Answer”, “text”: “Oui. OpenAI permet d’appeler différents modèles via son API, en fonction des besoins. Vous pouvez par exemple utiliser O4-mini pour les interactions rapides, et basculer sur O3 pour les tâches critiques ou longues.” } }, { “@type”: “Question”, “name”: “O4-mini est-il gratuit ?”, “acceptedAnswer”: { “@type”: “Answer”, “text”: “Cela dépend de l’usage. Dans ChatGPT gratuit, O4-mini peut être utilisé par défaut selon les cas. En revanche, l’accès via l’API est payant, mais moins coûteux que des modèles plus lourds comme O3.” } }, { “@type”: “Question”, “name”: “Comment savoir quel modèle j’utilise dans ChatGPT ?”, “acceptedAnswer”: { “@type”: “Answer”, “text”: “Si vous êtes abonné à ChatGPT Plus, vous utilisez par défaut la version la plus avancée disponible, souvent une combinaison dynamique de modèles (incluant O3 ou O4-mini selon la tâche). Les modèles exacts peuvent varier selon les mises à jour d’OpenAI.” } } ] }

Conclusion – O3 vs O4-mini : une dualité complémentaire

Avec l’arrivée de O4-mini, OpenAI propose une approche double : puissance avec O3, efficacité avec O4-mini. Plutôt que de choisir un vainqueur unique, ce comparatif met en lumière leur complémentarité.

Tu veux un modèle fiable, capable de comprendre des instructions complexes, avec une forte mémoire contextuelle ? O3 est fait pour toi.

Tu cherches une IA rapide, économique, idéale pour des intégrations produit ou des tâches simples ? O4-mini sera ton meilleur allié.

👉 Le meilleur choix dépend de ton usage. Et la bonne nouvelle, c’est qu’OpenAI te permet d’utiliser les deux.

Pour tirer le meilleur parti de ces modèles d’IA, explorez notre formation dédiée.

🚀 Besoin d’aide pour choisir et déployer la bonne solution ? Contactez l’Agence IA Stema Partners — cadrage, POC, intégration et MLOps : on s’occupe de tout.